Искусственный интеллект все теснее переплетается с вопросами национальной безопасности, что подтверждает недавнее соглашение OpenAI о внедрении своих технологий в компьютерные системы Министерства обороны США. Этот шаг не только обострил конкуренцию на рынке, но и привлек внимание к теме, которую часто упускают из виду, – к экологической цене нейросетей. Энергопотребление и углеродный след таких моделей, как ChatGPT от OpenAI и Claude от Anthropic, становятся ключевыми факторами для пользователей, организаций и климатических регуляторов.

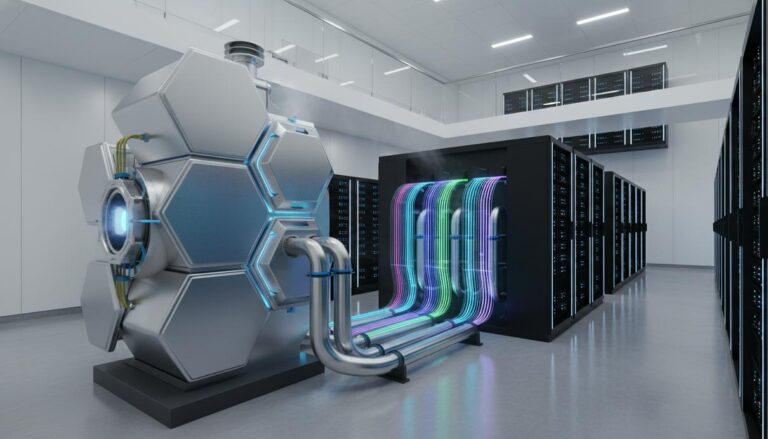

В основе работы любой ИИ-системы лежат огромные вычислительные сети – дата-центры, которые потребляют колоссальное количество электроэнергии и воды, производя при этом углекислый газ. Хотя энергия, затрачиваемая на один запрос к чат-боту, может показаться незначительной, миллиарды таких запросов ежедневно складываются в огромные цифры. Растущий спрос на электроэнергию со стороны ИИ-индустрии способен серьезно повлиять на глобальные объемы выбросов CO₂ в будущем.

Сравнение популярных моделей показывает существенные различия в их «аппетитах». Независимые исследования демонстрируют, что один запрос к GPT-4o (ChatGPT) потребляет около 0,30 ватт-часа (Вт·ч) и приводит к выбросу примерно 0,13 грамма CO₂ при использовании среднестатистической мировой электросети. В то же время его главный конкурент, Claude 3 Opus от Anthropic, требует значительно больше – 4,05 Вт·ч и 1,80 грамма CO₂ на запрос. Однако облегченная версия, Claude 3 Haiku, оказывается даже экономичнее ChatGPT – 0,22 Вт·ч и 0,10 грамма CO₂. Это доказывает, что архитектура и оптимизация модели могут изменять ее энергопотребление более чем в десять раз.

Энергетический жизненный цикл ИИ состоит из двух основных этапов. Первый – это обучение модели, разовый, но чрезвычайно энергоемкий процесс, который может привести к выбросам сотен тонн CO₂. Второй, на который приходится основная доля ежедневного потребления, – это использование или «умозаключение», когда модель отвечает на запросы пользователей. Именно здесь эффективность каждого отдельного запроса имеет решающее значение. Небольшая экономия энергии, умноженная на миллиарды операций, дает ощутимый экологический эффект.

Помимо электричества, дата-центры потребляют воду, в основном для охлаждения серверов. Хотя на один ИИ-запрос уходит всего около 0,32 миллилитра воды, в глобальном масштабе эти объемы становятся проблемой, особенно в регионах с дефицитом водных ресурсов. Отсутствие полной прозрачности со стороны технологических компаний затрудняет точную оценку воздействия, но уже сейчас понятно, что их вклад в глобальное потребление ресурсов будет только расти.

По некоторым прогнозам, к 2030 году на долю дата-центров может приходиться до 3–4% мирового потребления электроэнергии, и основной драйвер этого роста – именно искусственный интеллект. Если нынешние тенденции сохранятся, к 2035 году генеративный ИИ будет ответственен за выбросы миллионов тонн CO₂ ежегодно. Это подчеркивает, почему выбор более эффективных моделей и их разумное использование важны не только для рядовых пользователей, но и для формирования климатической политики и регулирования цифровых выбросов в мире, где ИИ становится повсеместным.